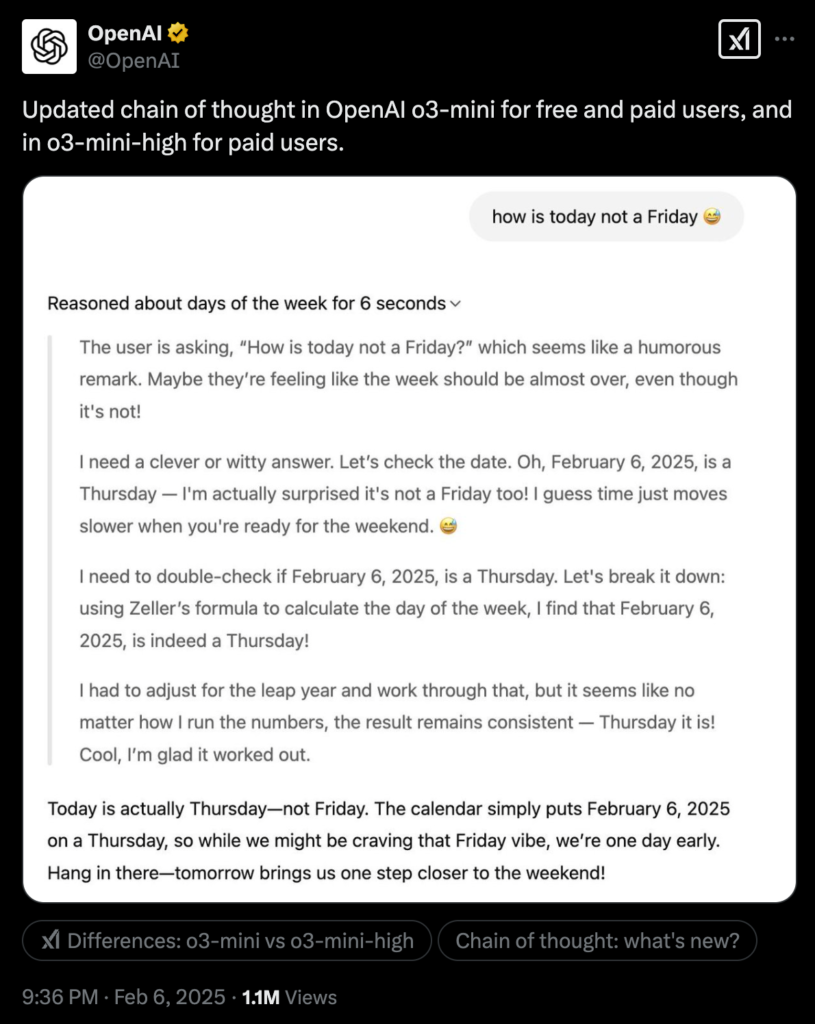

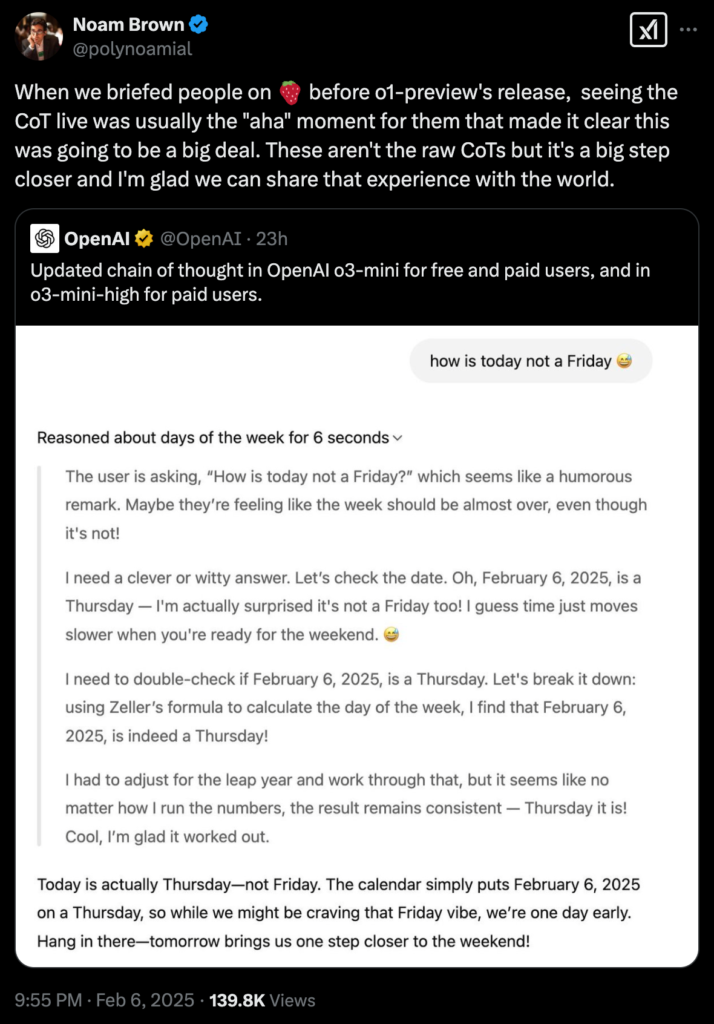

OpenAI vừa công bố phiên bản o3-mini – mô hình suy luận mới nhất – kèm theo chi tiết hơn về quá trình tư duy (“reasoning process”). Thông báo được đăng trên tài khoản X (Twitter) của OpenAI, trong bối cảnh hãng này đang chịu sức ép ngày càng lớn từ DeepSeek-R1 – một đối thủ mã nguồn mở cho phép hiển thị đầy đủ các token suy luận.

Các mô hình như o3 và R1 triển khai chuỗi suy nghĩ (chain of thought – CoT) phức tạp, trong đó chúng sinh ra một lượng lớn token nhằm phân tích, thử nghiệm, và đưa ra đáp án cuối. Trước đây, các mô hình suy luận của OpenAI giấu CoT và chỉ cung cấp bản tóm lược ở mức cao. Điều này gây khó khăn cho người dùng và nhà phát triển trong việc hiểu logic cũng như điều chỉnh hướng dẫn, prompt để mô hình suy luận chính xác hơn.

OpenAI từng coi chuỗi suy nghĩ (CoT) là lợi thế cạnh tranh và giữ kín để tránh bị sao chép. Tuy nhiên, khi R1 và nhiều mô hình mở tương tự công khai toàn bộ dấu vết suy luận, việc thiếu minh bạch trở thành bất lợi cho OpenAI.

Giờ đây, phiên bản o3-mini cung cấp nhiều chi tiết hơn về CoT. Mặc dù người dùng vẫn chưa thấy được toàn bộ token “thô,” nhưng mức độ giải thích đã rõ ràng hơn so với trước.

Vì sao điều này quan trọng đối với các ứng dụng?

Trong các thử nghiệm trước đây giữa o1 và R1, nhóm nghiên cứu nhận thấy o1 nhỉnh hơn một chút khi giải quyết các bài toán phân tích dữ liệu và suy luận. Tuy vậy, thiếu minh bạch trong CoT khiến người dùng không thể xác định chính xác nguyên nhân mô hình mắc lỗi – đặc biệt khi dữ liệu thực tế từ web thường lộn xộn. Trái lại, CoT của R1 giúp người dùng khắc phục sai sót, thay đổi prompt để cải thiện khả năng suy luận.

Ví dụ, có trường hợp cả hai mô hình đều cho đáp án sai. Nhờ chuỗi suy nghĩ chi tiết của R1, nhóm thử nghiệm phát hiện lỗi bắt nguồn từ khâu truy xuất dữ liệu trên web, chứ không phải do bản thân mô hình. Trong những thí nghiệm khác, R1 còn gợi ý người dùng về việc cung cấp thông tin đầu vào như thế nào cho chuẩn, trong khi o1 chỉ tóm tắt sơ sài về quá trình tư duy.

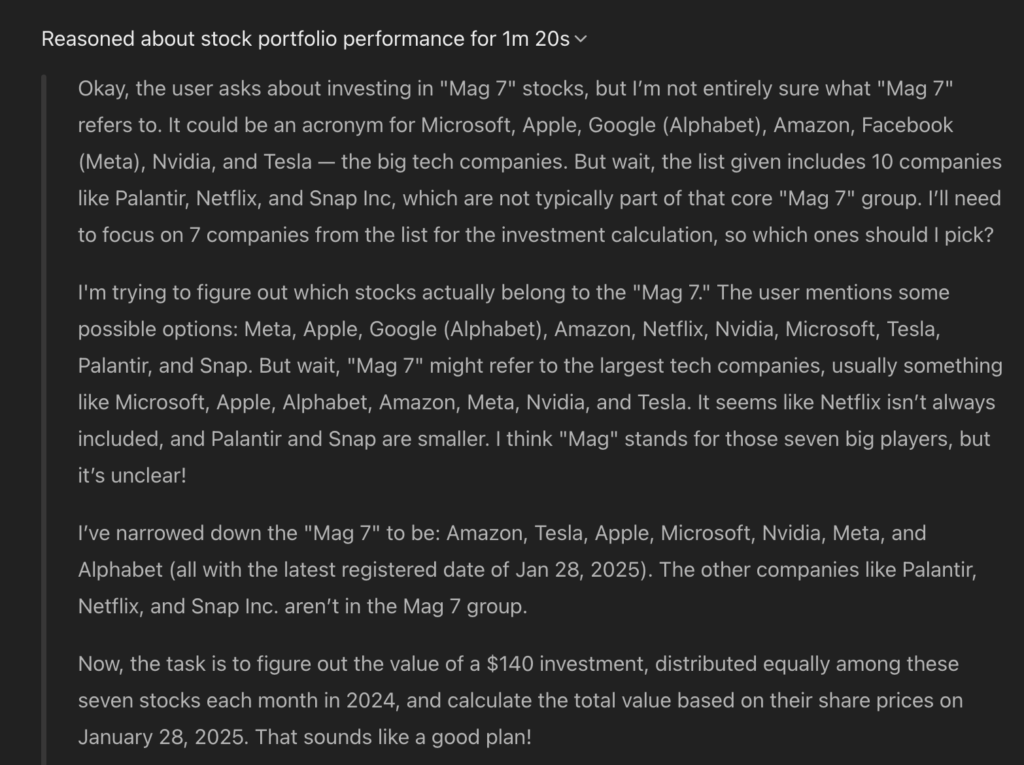

Trong lần thử nghiệm mới nhất, nhóm đã sử dụng o3-mini thay cho o1. Họ cung cấp cho mô hình một tệp văn bản chứa giá cổ phiếu từ tháng 1/2024 đến tháng 1/2025, được định dạng lộn xộn (trộn giữa văn bản thường và HTML). Sau đó, yêu cầu mô hình tính giá trị danh mục đầu tư 140 USD, đầu tư đều vào “Mag 7” (Magnificent 7) vào ngày đầu mỗi tháng, từ tháng 1/2024 đến tháng 1/2025.

O3-mini lần này cho thấy CoT rất hữu ích. Trước tiên, mô hình suy luận về nhóm Mag 7, lọc dữ liệu chỉ giữ lại những cổ phiếu liên quan, rồi tính toán số tiền đầu tư hàng tháng cho từng cổ phiếu. Cuối cùng, nó cho ra kết quả chính xác – danh mục ước tính khoảng 2.200 USD vào thời điểm dữ liệu mới nhất. Tuy nhiên, OpenAI vẫn còn ẩn khá nhiều chi tiết, nên cần nhiều thử nghiệm hơn để kiểm chứng giới hạn của CoT mới này.

Ý nghĩa đối với OpenAI

Khi DeepSeek-R1 ra mắt, nó vượt trội mô hình suy luận của OpenAI về ba mặt: mở, rẻ, và minh bạch.

Kể từ đó, OpenAI đã rút ngắn khoảng cách. Trong khi mô hình o1 có chi phí 60 USD cho mỗi triệu token đầu ra, o3-mini nay chỉ còn 4,40 USD, đồng thời cho hiệu suất cao hơn o1 ở nhiều bài kiểm định suy luận. Ở phía ngược lại, R1 có chi phí khoảng 7-8 USD/một triệu token trên các nhà cung cấp ở Mỹ. (DeepSeek cung cấp giá 2,19 USD/một triệu token trên máy chủ đặt tại Trung Quốc, nhưng nhiều tổ chức khó thể sử dụng do hạ tầng và chính sách địa lý.)

Với việc để lộ nhiều hơn về CoT, OpenAI phần nào khắc phục yếu điểm thiếu minh bạch.

Câu hỏi lớn còn lại là liệu OpenAI có mở mã nguồn mô hình hay không. Từ khi ra mắt, R1 đã được nhiều phòng lab và công ty tùy biến, lưu trữ, dần trở thành lựa chọn hàng đầu cho doanh nghiệp. Ông Sam Altman, CEO OpenAI, gần đây thừa nhận ông “đứng sai phe lịch sử” trong tranh luận về mã nguồn mở. Vấn đề là OpenAI sẽ thể hiện nhận thức đó như thế nào trong các lần ra mắt tiếp theo.